AutoML 動画分類モデルのトレーニング

概要

このラボでは、動画データセットの作成、動画のインポート、AutoML 動画分類モデルのトレーニング、バッチ予測を行うモデルのデプロイを行います。

学習目標

- 動画データセットを作成して動画をインポートする

- AutoML 動画分類モデルをトレーニングする

- バッチ予測を行うモデルをデプロイする

Vertex AI の概要

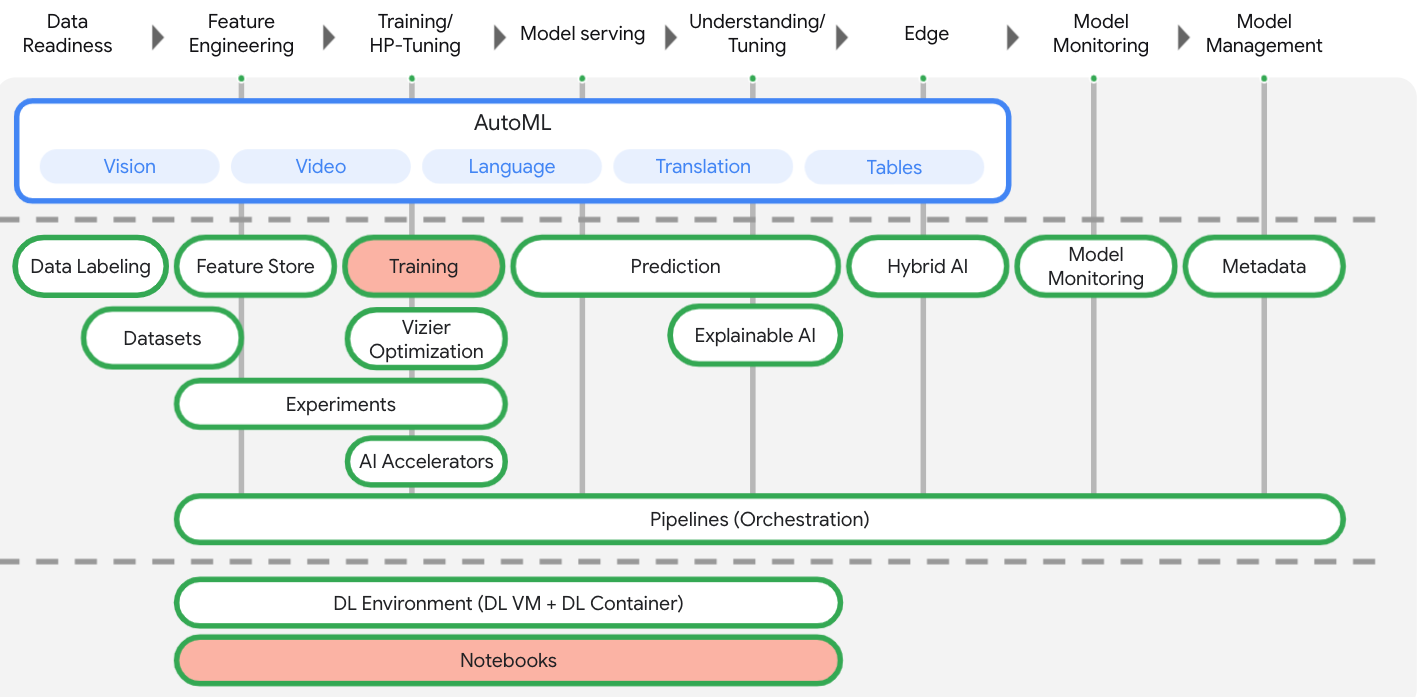

このラボでは、Google Cloud で利用できる最新の AI プロダクトを使用します。Vertex AI は Google Cloud 全体の ML サービスを統合してシームレスな開発エクスペリエンスを提供します。以前は、AutoML でトレーニングしたモデルやカスタムモデルには、個別のサービスを介してアクセスする必要がありました。Vertex AI は、これらの個別のサービスを他の新しいプロダクトとともに 1 つの API へと結合します。既存のプロジェクトを Vertex AI に移行することもできます。ご意見やご質問がありましたら、Google Cloud の Vertex AI サポートページからお寄せください。

Vertex AI には、エンドツーエンドの ML ワークフローをサポートするさまざまなプロダクトが含まれています。このラボでは、以下でハイライト表示されたプロダクト(トレーニング、ハイパーパラメータ調整、Notebooks)を取り上げます。

設定

各ラボでは、新しい Google Cloud プロジェクトとリソースセットを一定時間無料で利用できます。

-

Qwiklabs にシークレット ウィンドウでログインします。

-

ラボのアクセス時間(例:

1:15:00)に注意し、時間内に完了できるようにしてください。

一時停止機能はありません。必要な場合はやり直せますが、最初からになります。 -

準備ができたら、[ラボを開始] をクリックします。

-

ラボの認証情報(ユーザー名とパスワード)をメモしておきます。この情報は、Google Cloud Console にログインする際に使用します。

-

[Google Console を開く] をクリックします。

-

[別のアカウントを使用] をクリックし、このラボの認証情報をコピーしてプロンプトに貼り付けます。

他の認証情報を使用すると、エラーが発生したり、料金の請求が発生したりします。 -

利用規約に同意し、再設定用のリソースページをスキップします。

タスク 1. 環境の設定

API を有効にする

- Google Cloud コンソールのナビゲーション メニューで、[Vertex AI] > [ダッシュボード] をクリックします。

- [すべての推奨 API を有効化] をクリックします。

タスク 2. 動画データセットを作成して動画をインポートする

このタスクでは、動画データセットを作成します。データセットを作成したら、Cloud Storage バケットにコピーした動画を参照する CSV を使用して、動画をデータセットにインポートします。

-

[Vertex AI] ページで、[データセットの作成] をクリックします。

-

データセットの名前を入力します。

-

[データタイプと目標の選択] で、次の操作を行います。

a. データタイプに [動画] を選択します。

b. 目標に [動画分類] を選択します。

-

[リージョン] で、[us-central1] を選択します。

-

[作成] をクリックします。

データのインポート ウィンドウが表示されます。 -

[インポート方法を選択] で、[インポート ファイルを Cloud Storage から選択] を選択します。

-

[インポート ファイルのパス] に、次のテキストをコピーして貼り付けます。

cloud-training/mlongcp/v3.0_MLonGC/toy_data/hmdb_split1_5classes_all_toy.csv -

[データ分割] で、[デフォルト] を選択します。

-

[続行] をクリックして、動画のインポートを開始します。

インポートには数分かかります。完了すると [参照] タブが開き、新しくインポートされたデータが表示されます。

タスク 3. AutoML 動画分類モデルのトレーニング

データセットを作成してデータをインポートしたら、Cloud コンソールを使用してトレーニング動画を確認し、モデルのトレーニングを開始します。

AutoML モデルのトレーニングを開始する

-

右側のペインで [新しいモデルをトレーニング] をクリックします。

-

[トレーニング方法] で、[AutoML] を選択します。

-

[続行] をクリックします。

-

[モデルの詳細] の [モデル名] にモデルの名前を入力します。

-

[トレーニングを開始] をクリックします。

右側のペインの [トレーニング ジョブとモデル] セクションにトレーニング ジョブが表示されます。

現在のトレーニングのステータスを確認するには、右側のペインで該当するトレーニング ジョブをクリックします。モデルのトレーニング ページが表示されます。

評価結果を確認する

トレーニングが完了したら、モデルを選択してモデルの評価結果を確認します。[評価] タブが開きます。このタブで、モデルのパフォーマンス指標を確認できます。

タスク 4. バッチ予測を行うモデルをデプロイする

バッチ予測を作成する

-

[バッチ予測] タブで、[バッチ予測を作成] をクリックします。

-

バッチ予測の名前を指定します。

-

[転送元のパス] を automl-video-demo-data/hmdb_split1_predict.jsonl とします。

-

バケットの [宛先のパス] で、[参照] をクリックします。

-

[新しいバケットを作成] をクリックして「Project_ID」と入力します。

-

[作成] をクリックします。

-

[新しいフォルダを作成] をクリックして「predict_results」と入力します。

-

[作成] をクリックして宛先のパスを選択します。

-

[作成] をクリックします。

-

使用するバケット名を確認するには、[Cloud Storage] まで移動します。結果は、predict_results フォルダに追加されます。

結果を表示する

ジョブが完了すると、[バッチ予測] タブに予測が表示されます。

-

[バッチ予測] ビューで該当する予測をクリックします。

バッチ予測ジョブの詳細が表示されます。

-

[エクスポート ロケーション] リンクをクリックして、ストレージ バケットで結果を表示します。

-

UI で結果を確認するには、[結果を表示] をクリックします。

動画が表示されます。ページの上部にあるプルダウン メニューから、別の動画を選択して結果を確認できます。

結果を確認する

動画アノテーションの結果では、次の 3 種類の情報が提供されます。

- 動画のラベル: この情報は、結果ページの動画の下の [セグメント] タブにあります。

- 動画内のショットのラベル: この情報は、結果ページの動画の下の [ショット] タブにあります。

- 動画内の 1 秒間隔ごとのラベル: この情報は、結果ページの動画の下の [間隔] タブにあります。

予測が失敗した場合は、[最近の予測] リスト上の結果に赤色のアイコンが表示されます。

予測をリクエストした動画のうち 1 つだけが失敗した場合は、[最近の予測] リスト上の結果に緑色のアイコンが表示されます。予測の結果ページでは、Vertex AI でアノテーション付けされた動画の結果を確認できます。

ラボを終了する

ラボでの学習が完了したら、[ラボを終了] をクリックします。ラボで使用したリソースが Qwiklabs から削除され、アカウントの情報も消去されます。

ラボの評価を求めるダイアログが表示されたら、星の数を選択してコメントを入力し、[送信] をクリックします。

星の数は、それぞれ次の評価を表します。

- 星 1 つ = 非常に不満

- 星 2 つ = 不満

- 星 3 つ = どちらともいえない

- 星 4 つ = 満足

- 星 5 つ = 非常に満足

フィードバックを送信しない場合は、ダイアログ ボックスを閉じてください。

フィードバック、ご提案、修正が必要な箇所については、[サポート] タブからお知らせください。

Copyright 2020 Google LLC All rights reserved. Google および Google のロゴは Google LLC の商標です。その他すべての企業名および商品名はそれぞれ各社の商標または登録商標です。